虚拟人生成领域迎来了新的突破,Lyra Lab(腾讯音乐娱乐)的最新项目MusePose便是其中的佼佼者。作为一种姿态驱动的图像到视频框架,MusePose旨在将静态图像转化为动态视频序列,为虚拟人生成提供了前所未有的灵活性和真实感。

MusePose是什么?

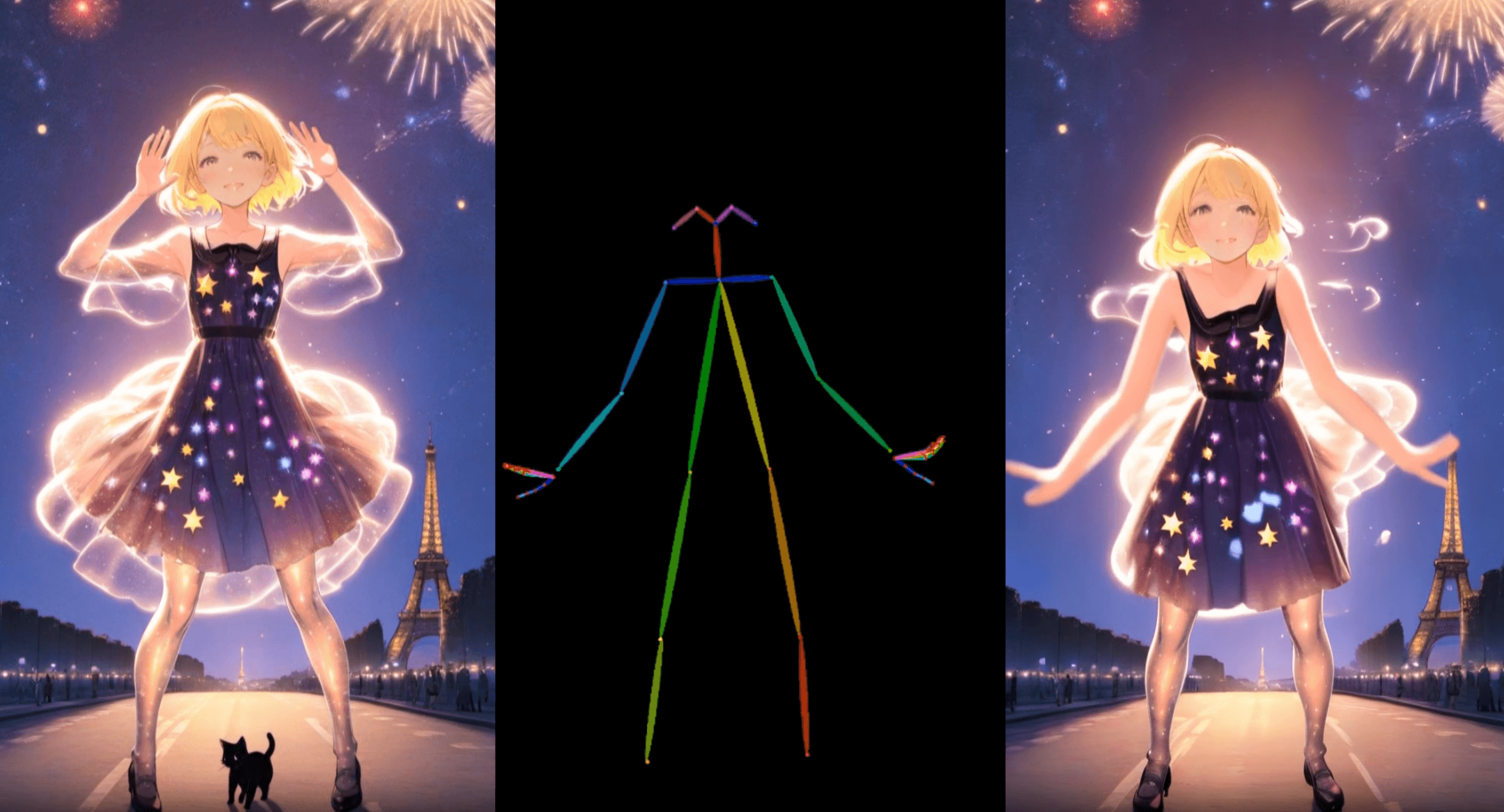

MusePose是一种先进的框架,设计用于通过给定的姿态序列从单一参考图像生成高质量的舞蹈视频。它利用先进的扩散模型和姿态对齐算法,生成与输入姿态高度匹配的平滑、逼真的动画。这一框架是Lyra Lab致力于虚拟人生成工具套件的一部分,其他工具还包括MuseV和MuseTalk。

主要特点和贡献

- 高质量视频生成:MusePose能够生成超越当前大多数开源模型质量的舞蹈视频,确保生成的视频在视觉保真度和运动过渡方面都保持高水准。

- 姿态对齐算法:该框架引入了一种姿态对齐算法,允许用户将任意舞蹈视频与任意参考图像对齐,大大提升了推理性能和模型的可用性。

- 增强的可用性和修复:在此前项目如AnimateAnyone的基础上,MusePose修复了多个重要的bug,并进行了若干改进,使其成为一个可靠且健壮的工具。

技术概述

MusePose通过首先将参考图像的姿态与目标舞蹈视频进行对齐来操作。这一对齐过程通过专门的姿态对齐算法实现,确保生成视频中的动作与预期姿态高度一致。框架随后使用基于扩散的方法生成视频帧,逐步优化输出以达到高质量的效果。

安装和设置

要开始使用MusePose,用户需要配置一个包含特定依赖项的Python环境,如OpenCV、Diffusers和若干mmlab包。安装过程相对简单,包括下载预训练权重和配置姿态对齐算法。详细的安装说明和依赖项列表可在项目的GitHub仓库中找到。

使用和应用

MusePose提供了用户友好的界面来生成视频。用户可以准备参考图像和姿态序列,进行姿态对齐,然后运行推理生成视频。框架支持多种自定义选项,包括调整分辨率以管理VRAM使用,以及增强脸部区域以获得更好的一致性。

未来发展

MusePose代表了虚拟人生成领域的重大进步,在娱乐、虚拟现实等领域具有广泛的应用前景。项目路线图包括发布更多训练模型、提供训练指南和改进架构等,这些未来的发展旨在提升框架的能力并扩大其适用性。

数智朋克点评

MusePose是一个强大且多功能的工具,能够从静态图像创建动态、逼真的虚拟人视频。其姿态驱动的方法和先进的扩散模型树立了这一领域的新标准,提供了前所未有的质量和灵活性。随着项目的不断发展,它有望推动虚拟人生成能力的进一步提升,并为数字媒体和互动体验开辟新的可能性。

粤公网安备44030002001270号

粤公网安备44030002001270号