在AI技术的飞速发展中,模型的开发并不是最大的挑战,如何高效、低成本地将这些模型部署到生产环境中,才是真正的难点。Mystic.ai 则通过其独特的设计思路,为这一过程带来了革命性的简化。

简化复杂的部署流程

Mystic.ai 的核心竞争力在于它的无服务器架构。这一架构使得用户无需为闲置资源付费,仅为实际使用的计算资源买单,从而大大降低了运营成本。这种灵活的计费模式使得中小企业能够更具成本效益地运行AI模型,避免了高昂的基础设施支出。

在功能上,Mystic.ai 提供了广泛的GPU支持,包括Nvidia A100、V100等多种型号,同时还支持GPU分片,允许多个模型在同一GPU上并行运行。对于计算密集型的AI任务来说,这种资源优化机制尤为关键,不仅提高了计算效率,还减少了冷启动时间,从而保证了模型的高可用性。

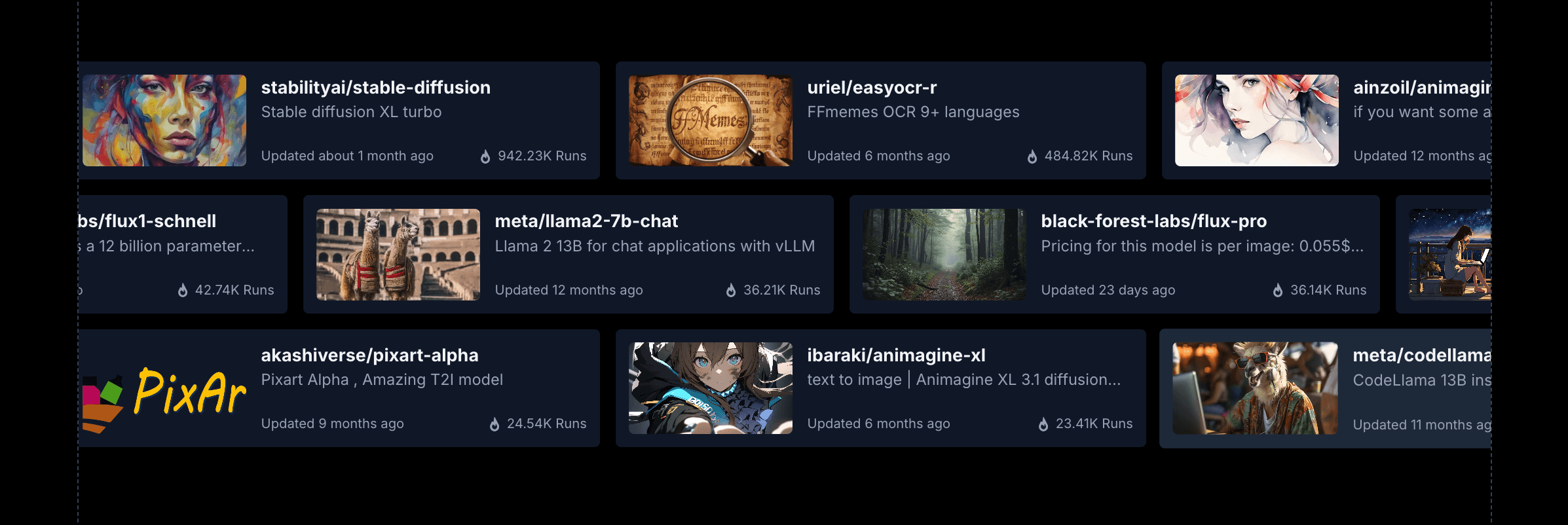

Mystic.ai 支持部署多种开源和定制的机器学习模型,这使得它在AI模型的生产化方面非常灵活。目前,平台主要支持以下几类模型部署:

-

大语言模型 (LLMs):Mystic.ai 允许用户部署各种大语言模型,例如GPT系列、BERT等。它通过集成vLLM和TensorRT等推理引擎,使这些模型能够以更低的延迟和更高的性能进行推理。

-

计算机视觉模型:Mystic.ai 还支持如YOLO、ResNet等计算机视觉模型的部署。这些模型可以用于图像识别、物体检测等场景,且能在平台提供的GPU环境中高效运行。

-

自定义模型:用户可以通过Mystic.ai的平台将自己定制的模型部署为API,无论这些模型是使用TensorFlow、PyTorch,还是其他框架开发的。这一特性极大地增强了平台的灵活性,适用于各种企业级应用。

-

生成模型:诸如Stable Diffusion、GANs等生成模型也可以在Mystic.ai上进行部署,适用于生成图像、音频或文本等内容的任务。通过Mystic.ai的优化,这些模型在部署时能够有效地利用GPU资源,提供快速的生成速度。

-

时间序列预测模型:平台同样支持用于金融预测、销售预测等领域的时间序列模型,如Prophet和ARIMA。这些模型的部署可以帮助企业在不同的业务场景中做出数据驱动的决策。

灵活且高效的市场定位

Mystic.ai 并不仅仅满足于为模型部署提供基础设施支持,它还深谙用户的多样化需求。平台提供的API接口、Python SDK和CLI工具,允许用户在他们选择的云环境中轻松集成和扩展AI模型。无论是AWS、GCP,还是Azure,Mystic.ai 都能无缝连接,并支持Bring Your Own Cloud(BYOC) 模式,让用户在自己的云环境中享受无服务器架构的灵活性。

这一切使得Mystic.ai 在市场上拥有了独特的定位,特别是在面对Google Cloud AutoML、Amazon SageMaker等强劲竞争对手时,依然能凭借其出色的成本控制和高效部署体验吸引大量用户。对于那些希望在云端运行AI模型,但又不希望被复杂的DevOps流程所困扰的团队来说,Mystic.ai 无疑是一个理想的选择。

市场反馈与用户评价

用户对Mystic.ai 的反馈普遍积极,特别是其透明的定价模式和优异的技术支持。免费试用期和多层次的订阅计划,为用户提供了从入门到专业级别的多种选择。这种灵活的定价策略,结合平台的强大功能,使得Mystic.ai 成为了许多开发者和企业的首选工具。

Mystic.ai 也面临着来自市场的挑战。像Amazon SageMaker和Google Cloud AutoML等成熟的AI平台,已经在市场上占据了重要地位。然而,Mystic.ai 凭借其更灵活的架构和卓越的用户体验,正在逐步积累自己的用户基础,并有望在未来的市场竞争中脱颖而出。

数智朋克点评

Mystic.ai 是一个令人印象深刻的工具,它不仅解决了AI模型部署的痛点,还通过创新的架构和灵活的定价模式,为用户提供了更多的选择。特别是在GPU资源的高效利用和部署流程的简化方面,Mystic.ai 展现出了强大的技术优势。随着AI应用的普及,像Mystic.ai 这样的平台无疑将在未来扮演更加重要的角色。

粤公网安备44030002001270号

粤公网安备44030002001270号