重新定义3D生成的边界

在计算机视觉领域,3D生成一直是一个挑战性的任务。传统上,这项任务依赖大量的3D数据来训练模型。然而,与图像、文本或视频相比,3D数据不仅难以获取,且数量相对稀少。这种数据的稀缺性限制了3D生成模型的发展。VFusion3D的出现,为这个问题带来了新的解决方案。

视频扩散模型的魔力

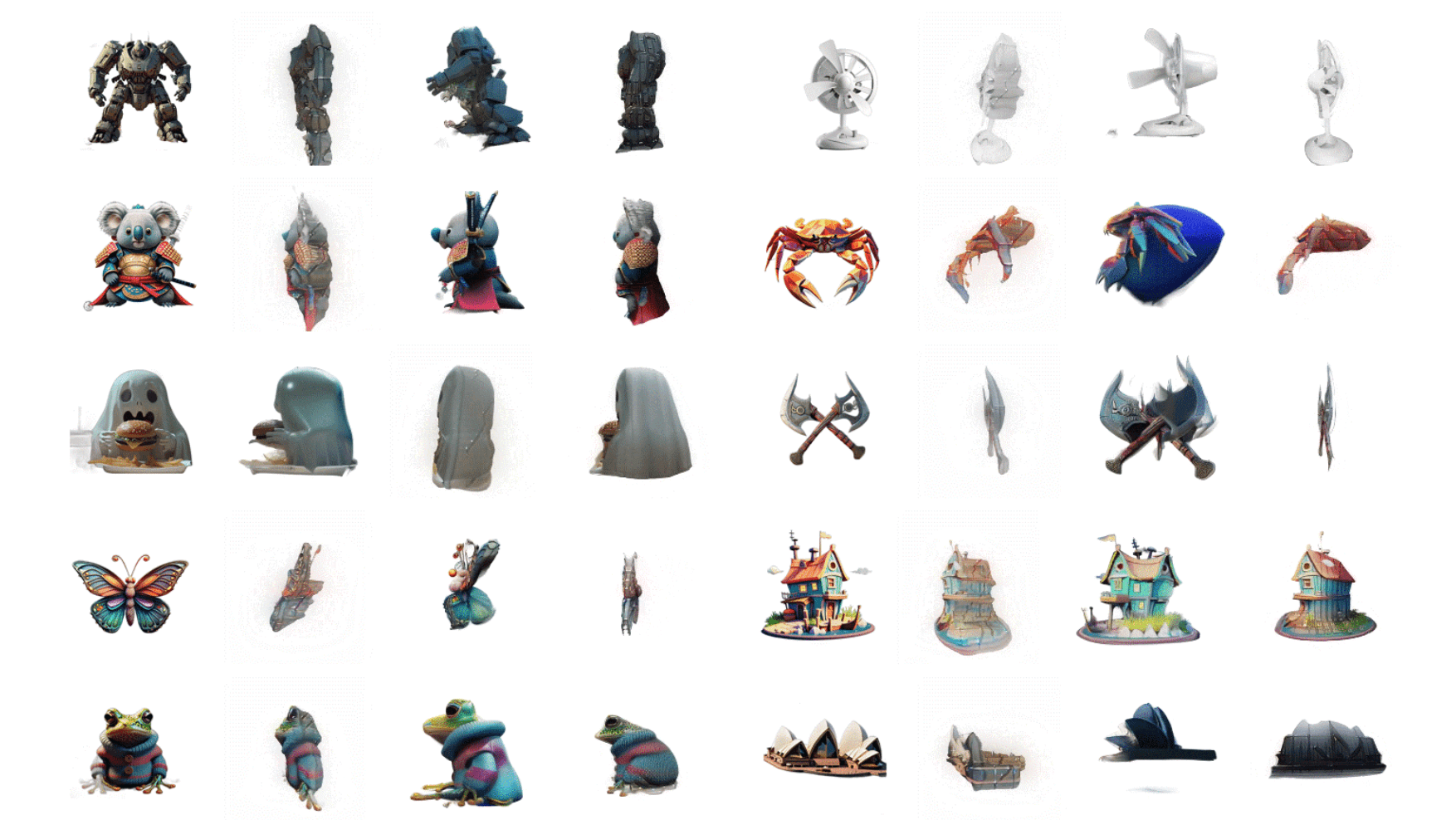

VFusion3D利用预训练的视频扩散模型作为核心,通过少量3D数据的微调,转化为多视角视频生成器。这一过程不仅充分利用了现有的视频、图像和文本数据,还通过生成大量的合成多视角数据来弥补3D数据的不足。最终,这些合成数据成为训练3D生成模型的基础,使得模型可以从单一图像生成3D资产。

性能与扩展性的完美结合

在多项测试中,VFusion3D不仅在生成质量上优于当前的前沿模型(如OpenLRM和LGM),还展示了其在数据扩展上的显著优势。随着合成数据集规模的扩大,生成质量持续提升。此外,该方法还展示了在视频扩散模型和3D生成模型的进一步发展中具有巨大的扩展潜力。

市场与应用前景

VFusion3D的出现为多个领域带来了潜在的变革,特别是在游戏开发、虚拟现实以及动画制作等需要高质量3D内容生成的行业。随着技术的成熟和推广,VFusion3D有望成为3D生成领域的重要工具。其生成速度显著提升,仅需17秒即可从一张图像生成3D资产。

VFusion3D背后的团队:跨越学术与科技的协作

VFusion3D项目背后的团队由来自学术界和科技界的多位杰出研究者组成,彰显了多学科协作的力量。这项研究主要由牛津大学和Meta的科学家共同完成,核心成员包括Junlin Han、Filippos Kokkinos和Philip Torr。

跨学科合作的力量

值得一提的是,VFusion3D不仅依托于牛津大学的学术资源,还得到了Meta(前Facebook)强大的技术支持。Meta的参与使得该项目在资源和计算能力上得到了大力支持,特别是在大规模数据集的生成和处理上。

数智朋克点评

VFusion3D令人印象深刻地将视频扩散模型与3D生成技术融合,解决了3D数据稀缺的瓶颈。它展示了一个聪明的策略,即通过扩展现有数据集的规模,提升生成效果。这种创新不仅在技术上独树一帜,更在应用上有广泛的前景,尤其是在虚拟现实、游戏开发等领域。

粤公网安备44030002001270号

粤公网安备44030002001270号